El Equipo Global de Investigación y Análisis de Kaspersky (GReAT) ha detectado anuncios en la darknet que ofrecen servicios de deepfake de vídeo y audio en tiempo real. Según estos anuncios, los precios parten de 50 dólares para vídeos falsos y 30 dólares para mensajes de voz fabricados, aumentando en función de la complejidad y la duración del contenido. Estos hallazgos se produjeron tras analizar múltiples plataformas en ruso e inglés.

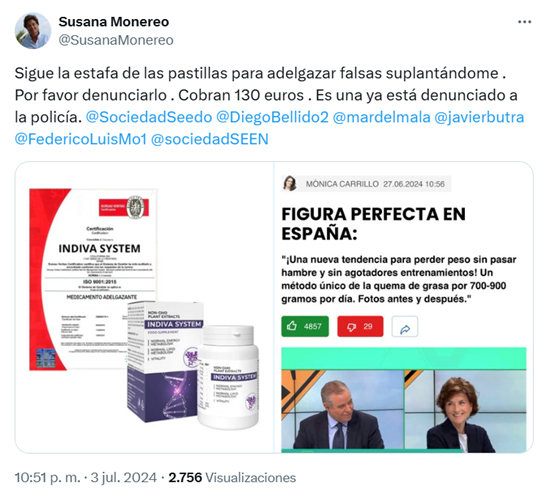

En investigaciones anteriores, Kaspersky había identificado servicios de creación de deepfakes en plataformas de la darknet con precios que oscilaban entre 300 y 20.000 dólares por minuto. Un ejemplo reciente de este tipo de fraude se produjo en España en 2024, cuando un deepfake suplantó la identidad de la doctora Susana Monereo, jefa de Endocrinología y Nutrición del Hospital Gregorio Marañón (Madrid), para promocionar falsamente pastillas de adelgazamiento en redes sociales.

De forma similar, en junio de este año, los ciberdelincuentes llegaron a usar la imagen de la presidenta de la Comunidad de Madrid, Isabel Díaz Ayuso, en anuncios falsos difundidos en X (Twitter). En estos vídeos manipulados se simulaba una entrevista televisiva en la que Ayuso supuestamente recomendaba una plataforma de inversión, con un formato que imitaba la identidad visual de RTVE. Según Verifica RTVE, ni la entrevista ni la promoción eran reales: se trataba de un deepfake diseñado para atraer a posibles inversores y redirigirlos a páginas fraudulentas

A diferencia de esos casos, las ofertas actuales permiten a los ciberdelincuentes generar contenido falso de audio y vídeo en tiempo real a un precio mucho más bajo. Los anuncios incluyen varias opciones, como el intercambio de rostros en tiempo real durante videollamadas en plataformas de videoconferencia o mensajería, la sustitución de la cara en procesos de verificación y la manipulación de la señal de la cámara en dispositivos.

Los autores de estas publicaciones afirman contar con software capaz de sincronizar las expresiones faciales de una persona en un vídeo con un texto, incluso en otros idiomas, así como herramientas de clonación de voz que permiten modificar el tono y timbre para transmitir emociones específicas. No obstante, es muy probable que muchos de estos anuncios sean en realidad fraudes dirigidos a estafar a posibles compradores.

“Ya no solo vemos anuncios que ofrecen ‘deepfake-as-a-service’, sino también una clara demanda de estas herramientas. Los actores maliciosos están experimentando mucho con la IA e incorporándola a sus operaciones. Algunas plataformas presentan capacidades más sofisticadas: por ejemplo, LLM maliciosos creados desde cero, independientes de los modelos disponibles públicamente, que se ejecutan en local. Aunque estas tecnologías no introducen amenazas cibernéticas totalmente nuevas, sí pueden potenciar de forma significativa la capacidad de los atacantes. En este contexto, los expertos en ciberseguridad debemos trabajar para contrarrestar estas amenazas. Una de las formas más efectivas es aprovechar la IA para aumentar la productividad de los profesionales de seguridad como la eficacia de las medidas defensivas”, afirma Dmitry Galov, jefe de Kaspersky Global Research and Analysis Team en Rusia y CIS.

En este sentido, para que las empresas se mantengan protegidas, los expertos recomiendan:

- Adoptar un enfoque de ciberinteligencia avanzado. No basta con tener soluciones de seguridad: las empresas necesitan visibilidad sobre las amenazas que pueden afectar a su marca o empleados. Los equipos de seguridad deben monitorizar foros de la darknet, detectar la compraventa de herramientas de deepfake y anticipar intentos de suplantación o fraude audiovisual antes de que se produzcan.

- Garantizar que los empleados comprendan qué son los deepfakes y por qué suponen una amenaza seria, ofreciendo formación periódica para reconocerlos y evitar su difusión.

- Enseñar al personal a identificar las señales clave de un deepfake: movimientos bruscos, iluminación inconsistente entre fotogramas, tonos de piel poco naturales, parpadeo inusual o ausente, distorsiones en la imagen y vídeos grabados intencionadamente en baja calidad o con mala iluminación.